Модуль Блокировщик роботов apf.blackhole

Модуль блокировки роботов, которые не являются официальными поисковиками, тем не менее индексируют сайт без учета robots.txt

Если посмотреть статистику сервера - нетрудно заметить что неопознанные роботы, не являющиеся крупными поисковиками - создают очень существенный трафик. Особенно это заметно на проектах с ресурсоемкими страницами. Вроде и посетителей не так много а сервер перегружен.

Принцип работы модуля предельно прост. Создается папка /blackhole/, индексация содержимого которой запрещается в robots.txt. На сайте, например в футере ставится незаметная ссылка на этот раздел, таким образом, чтобы посетитель сайта случайно туда не попал.

Соответственно на эту страницу будут заходить только роботы , которые игнорируют robots.txt, и индексирующие зачем то ваш сайт. Уважающие себя поисковики так не делают, так что игнорирование таких роботов не должно ухудшать видимость сайта в поисковиках.

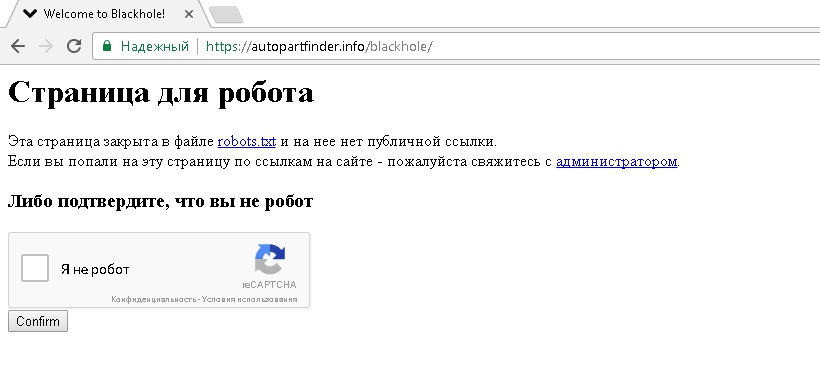

На всякий случай предусмотрена установка reCAPTCHA для отключения блокировки, если к примеру бот работает из публичной сети, либо в других случаях.

Страница "черной дыры" выглядит так

:

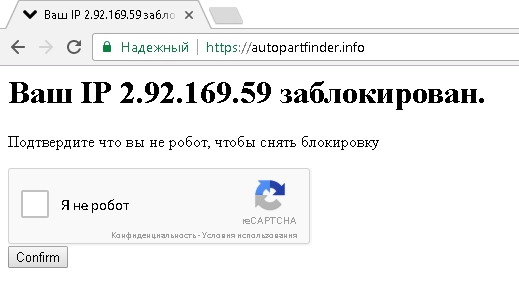

Если IP уже заблокирован - то пользователь (бот) всегда будет видеть такую страницу:

Большинство "левых" ботов передают user-agent как обычный браузер, и их выявить в статистике очень сложно.